1.★ 데이터 준비

필요하다면 전처리 하기!

결손값 처리, 누락값이 있으면 없애든지 다른값으로대체한다.

or 이상치를 제거한다.

# 중복되는 데이터가 많은면 없애는 것을 전처리 라고 함

# 데이터가 많을수록 정확도가 높아진다.

# 이중분류 : 2개중 하나를 고르는 것

# 다중분류 : 3개 이상중 하나를 고르는 것

# KNN 최근접 이웃 알고리즘 (K-최근접 이웃)

# 어떤 데이터가 있을때 최고 가까운 애들을 확인해서 가까운 나또한 애들 일 것 이다

# 사이킷런? (sckiet-learn) 머신러닝 패키지 / 2차원 리스트를 만들어야 사용 가능하다

# 피처 특성1나당 피처 ex 길이 , 무게

# 타겟 : 답을 설정 ex [1],[0] 설정을한다

2. 모델 학습

어떤 알고리즘을 모델로 사용할지 결정!

3. 모델에 의한 예측 수행

zip 관련

length = [5, 8, 10]

weight = [6, 9, 11]

z = zip(length, weight) # 인덱스 같은 애들끼리 묶어준다.

for i in z:

print(i)

#(5, 6)

#(8, 9)

#(10, 11)

● fit() 학습시키다 score() => 1.0 정확하게 맞추었다 , 0.5 절반맞춤, 0 오답

● predict() 특성만 주면 모델을 예측한다. 틀릴수도 있다.

# 도미 데이터 준비하기

bream_length = [25.4, 26.3, 26.5, 29.0, 29.0, 29.7, 29.7, 30.0, 30.0, 30.7, 31.0, 31.0, 31.5, 32.0, 32.0, 32.0, 33.0, 33.0, 33.5, 33.5, 34.0, 34.0, 34.5, 35.0, 35.0, 35.0, 35.0, 36.0, 36.0, 37.0, 38.5, 38.5, 39.5, 41.0, 41.0]

bream_weight = [242.0, 290.0, 340.0, 363.0, 430.0, 450.0, 500.0, 390.0, 450.0, 500.0, 475.0, 500.0, 500.0, 340.0, 600.0, 600.0, 700.0, 700.0, 610.0, 650.0, 575.0, 685.0, 620.0, 680.0, 700.0, 725.0, 720.0, 714.0, 850.0, 1000.0, 920.0, 955.0, 925.0, 975.0, 950.0]

# scatter()산점도를 그리는 함수

# matplotlib 과학계산용 그래프

import matplotlib.pyplot as plt # mataplotlib의 pylot 함수를 plt 로 줄여서 사용

plt.scatter(bream_length, bream_weight)

plt.xlabel('length') # x 축은 길이

plt.ylabel('weight') # y 축은 무게

plt.show()

# 빙어 데이터 준비하기

smelt_length = [9.8, 10.5, 10.6, 11.0, 11.2, 11.3, 11.8, 11.8, 12.0, 12.2, 12.4, 13.0, 14.3, 15.0]

smelt_weight = [6.7, 7.5, 7.0, 9.7, 9.8, 8.7, 10.0, 9.9, 9.8, 12.2, 13.4, 12.2, 19.7, 19.9]

# scatter()산점도를 그리는 함수

# matplotlib 과학계산용 그래프

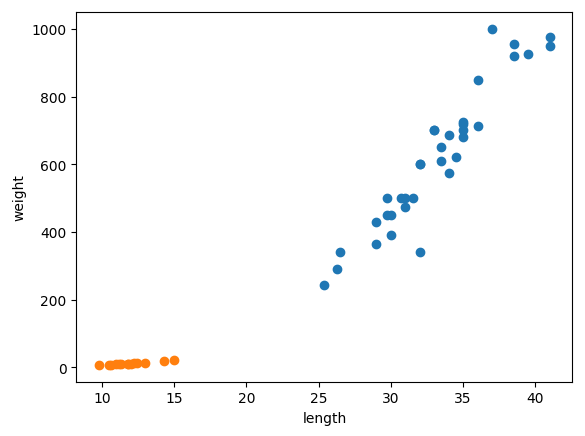

plt.scatter(bream_length, bream_weight) # 도미 길이 및 무게 데이터

plt.scatter(smelt_length, smelt_weight) # 빙어 길이 및 무게 데이터

plt.xlabel('length')

plt.ylabel('weight')

plt.show()

#K-최근접 이웃 K-Nearest Neighbors 알고리즘

length = bream_length + smelt_length

weight = bream_weight + smelt_weight

# 사이킷런scikit-learn

# 2차원 리스트로 만들었다.

fish_data = [[l,w] for l,w in zip(length,weight)]

print(fish_data)

fish_target = [1] * 35 + [0] * 14

print(fish_target)

===================================================================================

# 리스트 형식을 튜플로 바꾸어 주어야한다.

a = [1,2,3]

b = [4,5,6]

c = zip(a, b)

print(c)

list(c) # [(1,4),(2,5),(3,6)]

c = zip(a, b)

for i in c :

print(i)

#(1, 4)

#(2, 5)

#(3, 6)

=====================================================================================

# knn으로 학습할래~~

from sklearn.neighbors import KNeighborsClassifier

kn = KNeighborsClassifier()

# fit은 피쳐에 대한 타깃을 학습시키는 과정

kn.fit(fish_data, fish_target)

# score 는 학습 이후 성과를 평가하는 과정 , # 정확도를 확인한다.(모의고사) 0 ~ 1

kn.score(fish_data, fish_target)

plt.scatter(bream_length, bream_weight)

plt.scatter(smelt_length, smelt_weight)

plt.scatter(30, 600, marker='^')

plt.xlabel('length')

plt.ylabel('weight')

plt.show()

# predict 답을 예측하다.

kn.predict([[30,600]])

print(kn._fit_X)

print(kn._y)

kn49 = KNeighborsClassifier(n_neighbors=49)

kn49.fit(fish_data, fish_target)

kn49.score(fish_data, fish_target)

print(35/49)

'머신러닝+딥러닝' 카테고리의 다른 글

| 머신러닝 6일차 <군집 알고리즘> .2024.10.18 (4) | 2024.10.18 |

|---|---|

| 머신러닝 이진분류 와 다중분류 유방암데이터 와 붗꽃데이터 다중분류 (7) | 2024.10.16 |

| 머신러닝2일차 (연습) 몸무게와 키를 보고 여자인지 남자인지 확인해보자! (0) | 2024.10.16 |

| 머신러닝 1일차.2024.10.10. (0) | 2024.10.10 |